Säkerhetsutbildning

Agenda

-

01

Plattformsgenomgång

AI-modellvy och säkerhetsklassificeringar

-

02

Säkerhetskonfiguration

Definiera hierarkiska säkerhetsklasser och tilldela AI-modeller till varje klass

-

03

Arbeta med känslig information

Planera hantering av olika datatyper och intern kommunikation om säkerhet

-

04

Risk- och konsekvensbedömningar

Diskussion av organisatoriska krav

-

05

Personuppgiftsbiträdesavtal (PUB)

Granska och slutför PUB-avtal vid behov

Vad vi ska uppnå idag

Psykologisk och operativ säkerhet

Bygg en grund av tillit genom tydliga säkerhetsklassificeringar som ger alla trygghet i var och hur AI får användas

Ta bort rädsleblocket

Skapa en trygg grund för innovation genom att visa exakt vilken data som får användas var, så att era team kan säga "ja" till AI

Möjliggör smart beslutsfattande

Skapa olika "rum" för olika användningsfall – arbeta säkert med offentlig data i ett Space, känslig data i ett annat

Förenklad regelefterlevnad

Konfigurera ramverket en gång som administratörer, så att användarna inte behöver tänka på regelefterlevnad – det är inbyggt i plattformen

Säkerhetsklassificeringar

🏠 Tänk på Spaces som olika rum

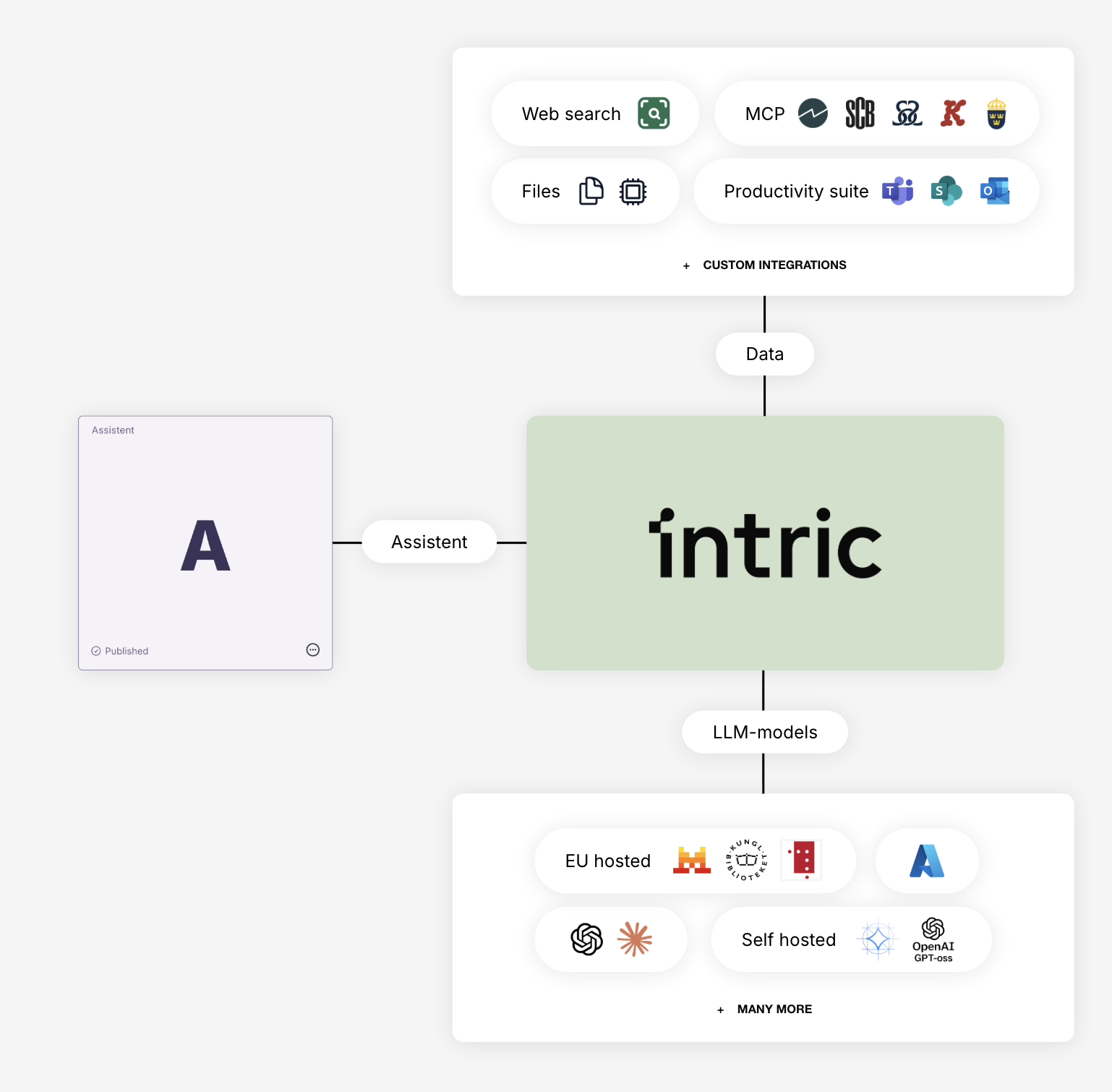

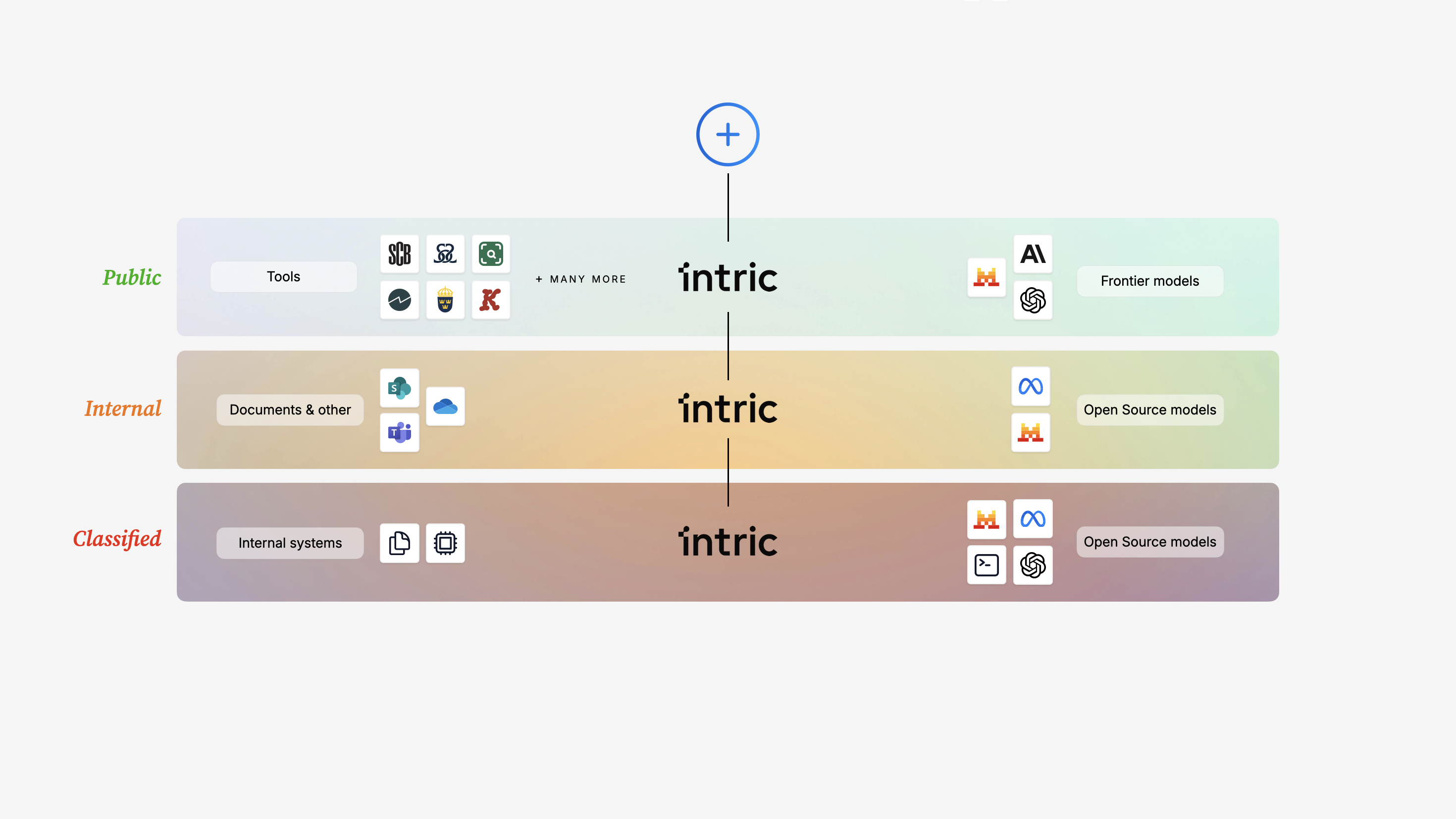

Olika processer har olika krav på funktionalitet, integrationer och säkerhet. I Intric kan ni skapa olika Spaces som fungerar som olika rum. Säkerhetsklasser skapar olika regler för dessa rum.

- 🟢Öppet rum – Offentlig data, full funktionalitet och AI-modeller tillgängliga

- 🇪🇺EU-rum – Data stannar inom EU, specifikt modellval

- 🇸🇪Sverige-rum – Data stannar i Sverige, mest begränsat modellval

📊 Hierarkisk struktur

Högsta klass överst: Sverige → EU → Öppen. Modeller som tillåts i en högre klass är automatiskt tillgängliga i lägre klasser, men inte tvärtom.

💡 Rekommenderad startpunkt

- 🎯Börja med öppen information – Skapa en säkerhetsklass för offentlig/öppen data för att snabbt komma igång

- 🔍Hitta enkla vinster – Låt teamen upptäcka värdefulla användningsfall utan höga trösklar

- 📋Bygg strategi parallellt – Medan användarna testar utvecklar administratörerna planer för hantering av känslig data

- 🔒Utöka gradvis – Lägg till fler säkerhetsklasser i takt med att er strategi och era rutiner mognar

🛠️ Ni konfigurerar en gång, användarna arbetar säkert

Som administratörer sätter vi reglerna. Era användare arbetar helt enkelt i rätt rum för sin uppgift – regelefterlevnaden är automatisk.

Arbeta med känslig information

🔍 Vilken data kommer ni att behandla?

Tänk kort och lång sikt:

- 🟢Icke-känslig information – Offentliga dokument, publicerade rapporter, allmän information

- 📋Personuppgifter – Namn, e-postadresser, kontaktuppgifter

- 🔐Särskilt skyddade personuppgifter – Personnummer, samordningsnummer

- ⚕️Känsliga personuppgifter – Hälsouppgifter, socialtjänstärenden

🎯 Skapa tydliga etiketter

Om ni endast tillåter "Öppen information", se till att säkerhetsklassens etikett tydligt informerar användarna om denna begränsning (t.ex. "Endast öppen data").

💬 Strategi för intern kommunikation

- 📢Tydliga riktlinjer – Kommunicera vilka rum (Spaces) som gäller för vilka datatyper

- 🎓Användarutbildning – Hjälp medarbetarna att förstå när de ska använda vilket Space

- ❓Stödkanaler – Etablera var användare kan ställa frågor eller begära undantag

- 📊Löpande uppdateringar – Håll kommunikationen uppdaterad i takt med att er AI-strategi utvecklas

⚖️ Möjliggör "ja"

Målet är inte att blockera AI-användning – det är att ge tydliga, säkra vägar framåt. Ge IT och juridik verktygen att säga "ja" till specifika användningsfall.

Riskbedömning och databehandling

📄 Personuppgiftsbiträdesavtal (PUB)

- 📝Syfte och omfattning – Vilken data behandlas och varför (utifrån er planerade användning)

- 🔒Säkerhetsåtgärder – Tekniska och organisatoriska säkerhetsåtgärder som Intric har på plats

- 🌍Datalagring – Var data behandlas (i linje med era säkerhetsklasser)

- 👥Underentreprenörer – AI-modellleverantörer (dokumenterade i våra resurser)

- ⏱️Kvarhållning och radering – Hantering av datans livscykel

🤝 Stöd för PUB

Intric tillhandahåller omfattande vägledning och stöddokumentation för PUB så att den juridiska granskningen blir enkel.

📋 Diskussion om konsekvensbedömning

- 🔍Omfång personuppgifter – Vilka personuppgifter kommer att behandlas? Hur känsliga är de?

- ⚖️Krav på DPIA – Behöver er organisation en konsekvensbedömning avseende dataskydd?

- 📊Organisatoriska krav – Vilka är era specifika risktoleransnivåer och krav på regelefterlevnad?

- 🔐Säkerhetsstandarder – Branschregler, interna policyer, lagkrav

🎯 Inbyggd riskreducering

Säkerhetsklassificeringar är er primära riskkontroll – de säkerställer att data endast behandlas av lämpliga AI-modeller i lämpliga sammanhang.