LLM

Åpenhet er sentralt for oss i Intric. Når du kommuniserer med en assistent i plattformen vår, er det spesifikke prosesser for å sikre personvernet og datasuvereniteten din.

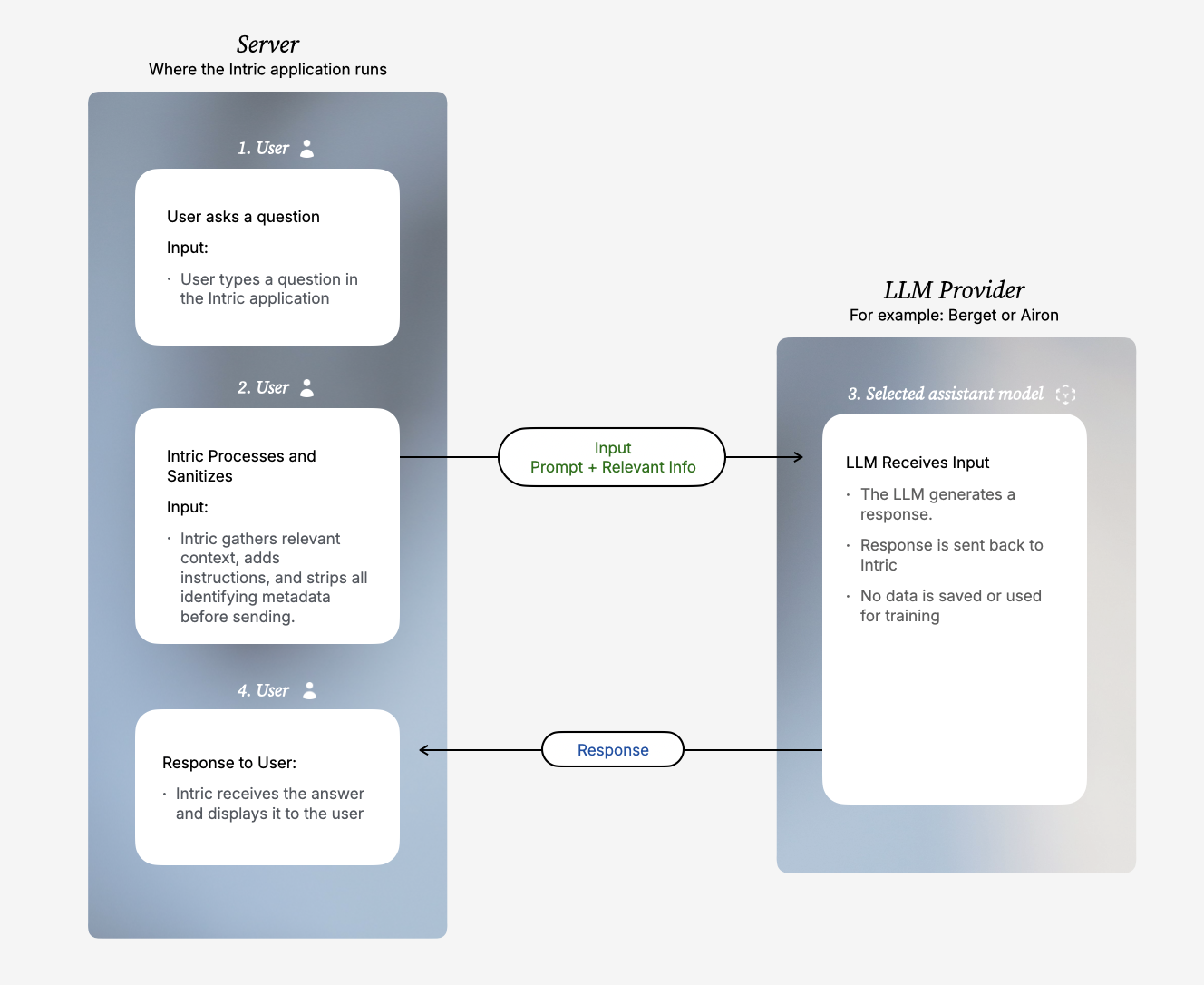

Prosessen fra spørsmålet ditt til et ferdig svar skjer gjennom en sikker interaksjon mellom Intric-plattformen (hvor dataene dine håndteres) og den LLM-leverandøren du har valgt (for eksempel Berget eller Airon).

Steg for steg: Slik håndteres dataene dine

Steg 1 — Bruker

Du stiller et spørsmål (Input).

Input: Prompten din, samtalehistorikk og eventuelle vedlegg.

Steg 2 — Intric (Server)

Intric behandler forespørselen før noe sendes til LLM-en.

Handling: Intric henter relevant bakgrunnsinformasjon for å besvare spørsmålet ditt og legger til nødvendige systeminstruksjoner. Vi sender nøyaktig det du skriver i prompten, men Intric fjerner strengt tatt all metadata—ingen informasjon om hvem som sendte det eller hvilken organisasjon det tilhører følger noen gang med.

Steg 3 — Valgt assistentmodell (LLM-leverandør)

LLM-en mottar forespørselen og genererer et svar.

Input: Promptinnholdet (ditt nøyaktige spørsmål + relevant informasjon fra Kunnskap eller Verktøy). Handling: LLM-en lager et svar utelukkende basert på den informasjonen som er gitt. Den har null kontekst om brukerens eller organisasjonens identitet. Umiddelbart etter at svaret er sendt tilbake, sletter LLM-leverandøren både inputen din og det genererte svaret.

Steg 4 — Bruker

Du mottar det endelige resultatet.

Handling: Intric mottar resultatet fra LLM-en og viser svaret til deg i brukergrensesnittet.

Datadeling og personvern

For å beskytte ditt og organisasjonens personvern bruker vi prinsippet om dataminimering. Det betyr at LLM-leverandøren kun får tilgang til det innholdet som er absolutt nødvendig for å utføre oppgaven—ingen brukeridentitet forlater noen gang infrastrukturen din.

I tabellen nedenfor ser du nøyaktig hvilke data som sendes til LLM-en og hva som holdes helt privat.

| Dette sendes til LLM-en | Dette sendes IKKE til LLM-en |

|---|---|

| Brukerens nøyaktige prompt/spørsmål | Bruker-ID, brukernavn eller navn |

| Systemprompt / instruksjoner | E-postadresser eller IP-adresser |

| Hentet relevant informasjon fra Kunnskap eller Verktøy som assistenten har tilgang til | Autentiseringstokens |

| Database-ID-er |

Oppsummering

Når du kommuniserer med en LLM gjennom Intric, forblir identiteten din helt privat. All brukermetadata håndteres lokalt og forlater aldri din kontroll. Den valgte LLM-leverandøren ser kun den isolerte teksten som trengs for å generere et nyttig svar. Intric har dessuten strenge null-datalagringsklausuler i alle avtalene våre med LLM-leverandører. Det garanterer at promptene dine og de genererte svarene verken lagres av leverandøren eller brukes til å trene deres AI-modeller.