LLM

Transparenz ist für uns bei Intric zentral. Wenn du mit einem Assistenten in unserer Plattform interagierst, sorgen klare Prozesse für deine Privatsphäre und Datensouveränität.

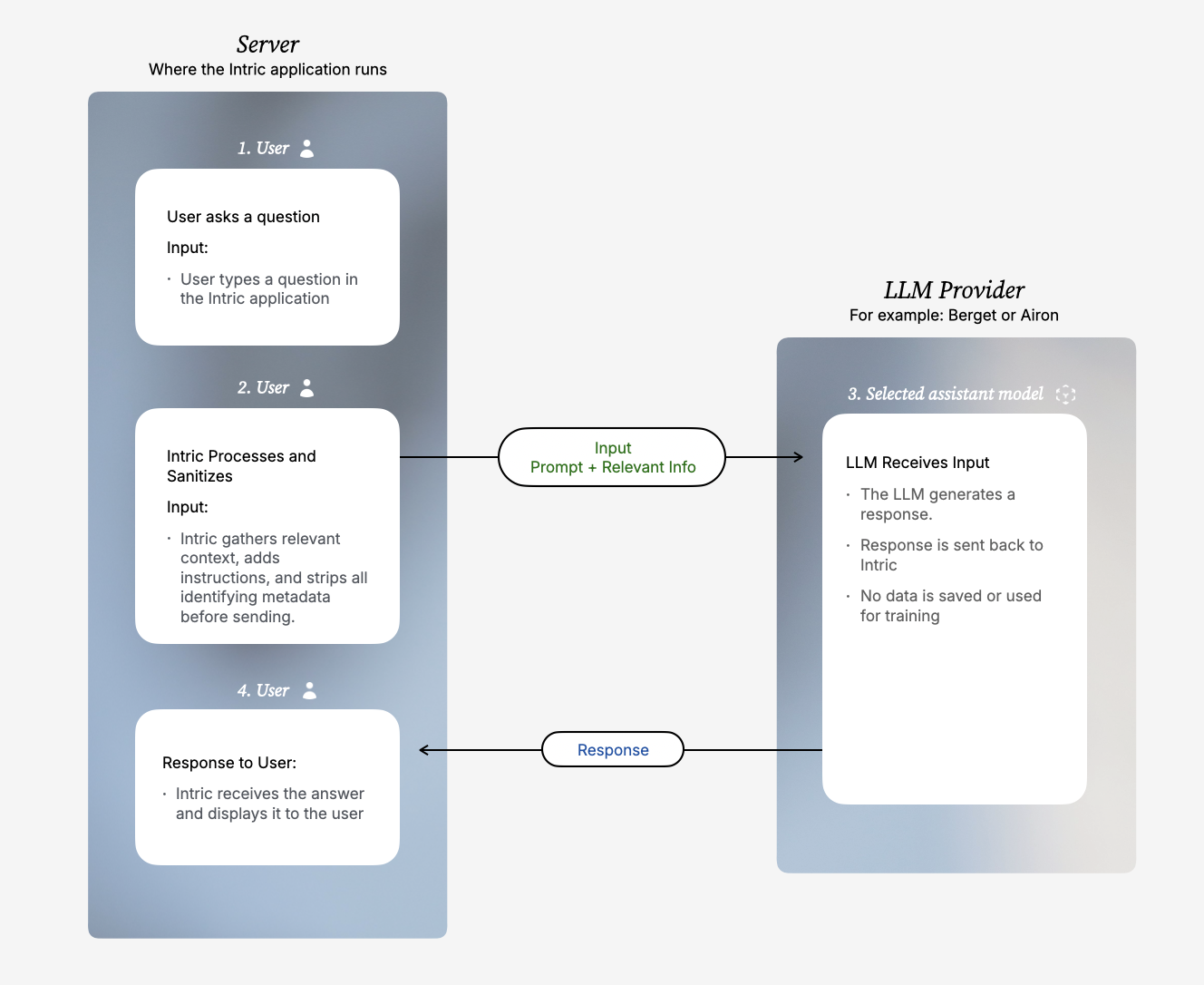

Der Prozess von deiner Frage bis zur fertigen Antwort erfolgt durch eine sichere Interaktion zwischen der Intric-Plattform (wo deine Daten verwaltet werden) und deinem gewählten LLM-Anbieter (z. B. Berget oder Airon).

Schritt für Schritt: So werden deine Daten verarbeitet

Schritt 1 — Benutzer

Du stellst eine Frage (Eingabe).

Eingabe: Dein Prompt, Chatverlauf und eventuelle Anhänge.

Schritt 2 — Intric (Server)

Intric verarbeitet die Anfrage, bevor etwas an den LLM gesendet wird.

Aktion: Intric ruft relevante Hintergrundinformationen ab, um deine Anfrage zu beantworten, und ergänzt nötige Systemanweisungen. Wir senden genau das, was du in den Prompt eingibst; Intric entfernt jedoch strikt alle Metadaten—es werden keine Informationen darüber, wer die Anfrage gesendet hat oder zu welcher Organisation sie gehört, mitgesendet.

Schritt 3 — Gewähltes Assistentenmodell (LLM-Anbieter)

Der LLM erhält die Anfrage und erzeugt eine Antwort.

Eingabe: Der Prompt-Inhalt (deine exakte Frage + relevante Informationen aus Wissen oder KI-Tools). Aktion: Der LLM erstellt eine Antwort ausschließlich auf Basis der bereitgestellten Informationen. Er hat keinen Kontext zur Identität des Benutzers oder der Organisation. Unmittelbar nach dem Zurücksenden der Antwort löscht der LLM-Anbieter sowohl deine Eingabe als auch die erzeugte Antwort.

Schritt 4 — Benutzer

Du erhältst das Endergebnis.

Aktion: Intric erhält das Ergebnis vom LLM und zeigt dir die Antwort in der Benutzeroberfläche an.

Datenaustausch und Privatsphäre

Zum Schutz deiner und der Privatsphäre deiner Organisation wenden wir das Prinzip der Datenminimierung an. Der LLM-Anbieter erhält nur Zugriff auf den Inhalt, der für die Aufgabenerfüllung unbedingt nötig ist—deine Benutzeridentität verlässt deine Infrastruktur nie.

In der folgenden Tabelle siehst du genau, welche Daten an den LLM gesendet werden und was vollständig privat bleibt.

| Das wird an den LLM gesendet | Das wird NICHT an den LLM gesendet |

|---|---|

| Der exakte Prompt/die Frage des Benutzers | Benutzer-ID, Benutzername oder Name |

| System-Prompt / Anweisungen | E-Mail-Adressen oder IP-Adressen |

| Abgerufene relevante Informationen aus Wissen oder KI-Tools, auf die der Assistent Zugriff hat | Authentifizierungs-Tokens |

| Datenbank-IDs |

Zusammenfassung

Wenn du über Intric mit einem LLM kommunizierst, bleibt deine Identität vollständig privat. Alle Benutzer-Metadaten werden lokal verarbeitet und verlassen nie deine Kontrolle. Der gewählte LLM-Anbieter sieht nur den isolierten Text, der für eine nützliche Antwort nötig ist. Darüber hinaus haben wir in allen Verträgen mit LLM-Anbietern strenge Klauseln zur Null-Datenspeicherung. So ist garantiert, dass deine Prompts und die erzeugten Antworten weder vom Anbieter gespeichert noch zum Training seiner KI-Modelle genutzt werden.